L’essor des technologies d’intelligence artificielle appliquées au visuel marque une transition majeure dans la manière dont l’image et la vidéo sont produites, modifiées et interprétées. En quelques années, les modèles de génération ont dépassé le simple traitement d’image pour devenir de véritables moteurs de transformation, capables d’altérer le mouvement, les expressions ou même la continuité d’une scène complète. Cette évolution rapide redéfinit les usages créatifs, professionnels et techniques, tout en révélant un potentiel qui s’étend bien au-delà des applications traditionnelles de l’IA.

Les nouveaux systèmes se caractérisent par une capacité à intégrer l’analyse du contexte visuel, la synthèse de textures, la création de transitions fluides et la reconstitution réaliste de détails complexes. L’apparition de modèles vidéo avancés ouvre un champ inédit pour la production de contenus narratifs courts, d’expériences personnalisées ou de scènes entièrement reconstruites. Cette progression reflète une tendance globale : offrir des outils plus libres, plus adaptatifs et plus proches du rendu humain.

Résumé des points abordés

Une génération d’IA visuelles pensées pour modifier le contenu en temps réel

Les modèles qui dominent aujourd’hui le paysage de l’intelligence artificielle visuelle reposent sur des architectures capables non seulement d’analyser des images, mais aussi de les transformer de manière cohérente d’une frame à l’autre. Là où les premières solutions se limitaient à retoucher un instant figé, les technologies actuelles intègrent la dimension temporelle : mouvement, dynamique faciale, fluctuations de lumière, micro-textures et continuité narrative sont désormais traités comme un ensemble. Cette évolution est liée à l’apparition de modèles d’analyse multi-niveaux, capables d’identifier la structure globale d’un plan tout en affinant des éléments beaucoup plus détaillés, comme la manière dont une lumière glisse sur une peau, la variation subtile d’un regard ou la déformation naturelle d’un objet en mouvement. Ces systèmes deviennent suffisamment précis pour adapter leurs calculs en fonction du contexte, qu’il s’agisse d’un simple ajustement d’expression ou d’un changement complet de mouvement. Les progrès réalisés dans les modèles vidéo à diffusion permettent également de générer de nouveaux plans à partir d’une seule image. L’utilisateur fournit un point de départ, l’IA reconstruit la suite logique en tenant compte des lois physiques apparentes, du positionnement dans l’espace, ou encore de la direction implicite du mouvement. Cette capacité à prolonger ou réinventer une scène ouvre un potentiel considérable pour les créateurs, puisqu’elle réduit le besoin de capturer de longues séquences pour obtenir un résultat fluide.

D’autres innovations reposent sur l’interprétation simultanée de plusieurs couches de données : la posture globale, les variations locales de texture, la synchronisation labiale ou encore l’alignement des ombres. Ce traitement multi-dimensionnel permet d’obtenir des résultats d’un réalisme inattendu, d’autant plus que les modèles modernes peuvent ajuster la cohérence d’une scène en plein processus, sans exiger de rééchantillonnage complet.

Cette nouvelle génération d’IA visuelles se distingue aussi par une approche plus adaptative. Les systèmes actuels sont conçus pour répondre à des intentions variées : créer une continuité fictionnelle, réanimer une photographie, transformer un portrait en séquence vidéo, ajuster le mouvement d’une scène ou encore construire une représentation entièrement nouvelle à partir de fragments visuels. Cette flexibilité marque une rupture avec les outils plus rigides des années précédentes.

Enfin, ces technologies ne se limitent plus à exécuter une instruction unique : elles analysent les nuances, les transitions et l’ensemble du contexte pour offrir un résultat cohérent, dense et extrêmement proche du rendu naturel. Le défi actuel n’est plus seulement d’imiter la réalité, mais de proposer une transformation capable de la prolonger, de la remodeler ou de la réinterpréter sans rupture visible.

Les nouvelles approches vidéo de l’intelligence artificielle et leurs usages émergents

Les modèles vidéo de dernière génération se distinguent par leur capacité à interpréter une séquence comme un ensemble cohérent plutôt qu’une accumulation d’images indépendantes. Grâce à une lecture simultanée des mouvements, des micro-variations de texture et des transitions lumineuses, ils reproduisent un comportement visuel qui se rapproche de plus en plus de celui perçu dans des captations réelles. Cette évolution, longtemps considérée comme difficile à atteindre, repose sur l’amélioration des réseaux de diffusion et sur l’analyse conjointe de plusieurs dimensions d’un même plan. Ces progrès se traduisent par une plus grande liberté dans la façon de transformer un contenu visuel. Certaines solutions permettent d’adapter la dynamique d’une scène, de prolonger un geste ou de réorienter le mouvement d’un sujet sans rupture perceptible. Là où les anciennes architectures imposaient des limites strictes, les systèmes actuels donnent davantage de latitude à l’utilisateur, tout en maintenant un niveau de cohérence qui consolide le réalisme final. L’un des points majeurs réside dans l’intégration temps réel : l’IA peut ajuster ses calculs au fur et à mesure, en tenant compte des évolutions du plan et des contraintes visuelles locales.

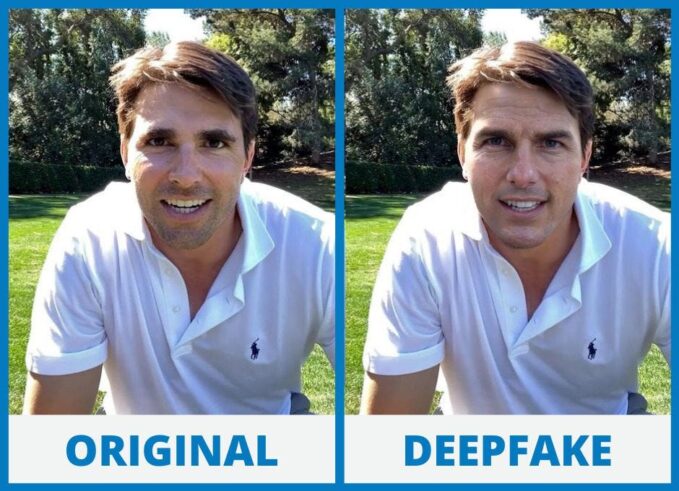

C’est dans ce contexte que certaines plateformes introduisent des mécanismes davantage orientés vers la souplesse d’usage. Elles s’appuient sur des modèles entraînés à anticiper les variations de mouvement ou les changements de perspective, afin de produire des transitions plus naturelles. L’utilisateur n’est plus limité à une simple retouche, mais peut réinventer le déroulement d’une séquence complète à partir d’un point de départ fixe. Les transformations générées ne se réduisent plus à un effet artificiel : elles dialoguent avec l’ensemble de la scène, ajustent les ombres, recalculent la cohérence de la lumière et maintiennent une continuité fluide entre les frames. Dans cette évolution, une attention particulière est portée à l’interprétation du visage et du mouvement humain, deux éléments historiquement difficiles à reproduire de manière stable. Les nouveaux modèles prennent désormais en charge la synchronisation des micro-expressions, l’ajustement naturel d’un regard ou les variations musculaires invisibles à l’œil non entraîné. Cette finesse de calcul contribue à établir un rendu nettement plus crédible, que ce soit pour la création de contenus courts, l’ajout d’éléments narratifs ou la production de séquences personnalisées. L’objectif actuel n’est plus seulement de copier une apparence, mais de maintenir l’ensemble du comportement visuel lié à cette apparence.

Dans les environnements de création numérique, cette capacité de transformation ouvre de nouvelles perspectives : enrichir un plan existant, produire une scène alternative ou adapter une narration visuelle à un autre contexte sans devoir recapturer du matériel source. C’est précisément cet élargissement fonctionnel qui attire l’attention de nombreux créateurs. Certains outils se démarquent par une approche plus ouverte, offrant une amplitude de modification plus large et une gestion plus fine du réalisme. Cette orientation se retrouve notamment dans l’intégration d’un moteur visuel IA à capacités étendues, conçu pour répondre à des scénarios variés allant de la simple adaptation d’un mouvement jusqu’à la reconstruction complète d’une séquence visuelle.

L’essor de ces technologies marque un tournant dans la manière dont les outils de génération vidéo s’intègrent dans les pratiques créatives. Plus rapides, plus précis et surtout plus adaptatifs, ils donnent accès à un niveau de contrôle auparavant réservé à des processus lourds ou à des solutions professionnelles hautement spécialisées. Cette tendance laisse entrevoir une utilisation beaucoup plus large : conception de récits, réinterprétation d’images, production audiovisuelle allégée ou création d’expériences personnalisées. L’intelligence artificielle vidéo ne se contente plus de reproduire ; elle construit, transforme et étend les possibilités de représentation.

Des outils plus flexibles pour une création visuelle affranchie des contraintes traditionnelles

L’évolution récente des modèles d’intelligence artificielle appliqués au visuel met en évidence une tendance claire : la recherche de systèmes capables de s’adapter aux intentions de l’utilisateur sans imposer de cadre rigide. Cette flexibilité devient aujourd’hui un élément central dans le développement des nouveaux outils, car elle répond à un besoin croissant de produire des contenus qui s’écartent des structures classiques. Les architectures contemporaines peuvent analyser des données complexes tout en permettant une modification globale du rendu, qu’il s’agisse de réinterpréter un mouvement, d’ajuster une dynamique ou de construire une continuité narrative entièrement nouvelle. Ce changement d’orientation s’explique en grande partie par la manière dont les modèles modernes apprennent à traiter les variations. Contrairement aux anciennes approches, qui s’appuyaient principalement sur des règles figées et des séquences limitées, les systèmes actuels intègrent une compréhension probabiliste du comportement visuel. Cela signifie qu’ils peuvent adapter leur calcul en fonction de l’évolution d’une scène et de ses détails, permettant une marge d’ajustement beaucoup plus large. Cette interprétation dynamique permet de recomposer un plan sans générer de ruptures évidentes, tout en maintenant une cohérence globale qui donne l’impression d’un tournage réel.

Dans la création visuelle contemporaine, cette adaptabilité représente un levier important pour construire des contenus plus personnalisés et plus narratifs. Les outils peuvent prolonger un geste, réorienter une action, transformer un visage ou modifier une scène entière avec un niveau de fluidité qui n’était pas accessible auparavant. Les utilisateurs, qu’ils évoluent dans la production audiovisuelle, la communication numérique ou les récits visuels courts, bénéficient ainsi d’une capacité de transformation beaucoup plus étendue. La frontière entre traitement d’image, animation et génération vidéo s’amenuise, laissant apparaître une zone hybride où l’IA assure une continuité crédible entre plusieurs types de médias. L’un des aspects les plus intéressants de cette évolution concerne l’intégration de comportements subtils. Les systèmes parviennent désormais à gérer des micro-changements qu’un œil non averti ne distinguait pas encore récemment : légères contractions musculaires, variations d’ombre, micro-ajustement d’un regard ou d’un déplacement. Ces détails, presque imperceptibles, constituent pourtant le cœur du réalisme visuel. En les reproduisant avec précision, les modèles renforcent l’authenticité des transformations et donnent aux séquences générées une dimension beaucoup plus naturelle.

Dans ce contexte, les créateurs commencent à utiliser ces technologies pour des usages beaucoup plus variés qu’auparavant. Certains s’en servent pour prolonger une scène en fonction d’un script, d’autres pour réadapter un visage à un autre environnement visuel, et d’autres encore pour produire de courts récits à partir d’une simple image. Ce qui rend ces pratiques possibles n’est pas seulement la puissance des algorithmes, mais la capacité à laisser l’utilisateur définir l’objectif sans devoir contourner des contraintes techniques restrictives. La logique moderne favorise des environnements où la transformation n’est plus seulement un ajustement, mais un véritable prolongement créatif.

Pour illustrer ces possibilités, plusieurs situations montrent comment ces technologies s’adaptent à différents contextes :

- adaptation visuelle d’un mouvement ou d’une posture dans une courte séquence

- création de variantes narratives à partir d’un même point de départ

- prolongation réaliste d’une action capturée sur une seule image

- ajustement précis de micro-expressions pour renforcer la crédibilité d’un portrait vidéo

- reconstitution d’une continuité visuelle cohérente dans un plan entièrement recréé

L’ensemble de ces avancées confirme une réalité : les outils visuels basés sur l’intelligence artificielle ne visent plus uniquement à simplifier la retouche, mais à offrir un espace de création beaucoup plus large, où le réalisme se combine avec une liberté d’interprétation plus ouverte. Cette fusion entre précision technique et flexibilité d’usage ouvre la voie à des scénarios visuels qui, il y a encore peu, nécessitaient des moyens lourds ou des compétences spécialisées. Désormais, la transformation se fait plus fluide, plus cohérente et surtout plus accessible pour adapter les contenus à des intentions multiples, qu’elles soient artistiques, narratives ou techniques.